Comprendre l’optique en photo : les 4 principes qui expliquent 100 % de tes images

Photo mise en avant : La lumière ne ment jamais, elle révèle simplement ce que l'optique lui permet d'exprimer.

Tu as déjà remarqué que certaines photos ont ce fond flou qui met ton sujet en valeur, pendant que d’autres semblent nettes de bout en bout? Que certaines images captent des couleurs éclatantes alors que d’autres semblent ternes? Que le bruit apparaît dans certaines situations mais pas dans d’autres?

Tout ça, ce n’est pas de la magie. Ce n’est pas non plus une question de chance ou d’appareil photo hors de prix. C’est de la physique. Plus précisément, c’est une seule et même science qui explique absolument tout ce que tu vois dans une photographie : l’optique.

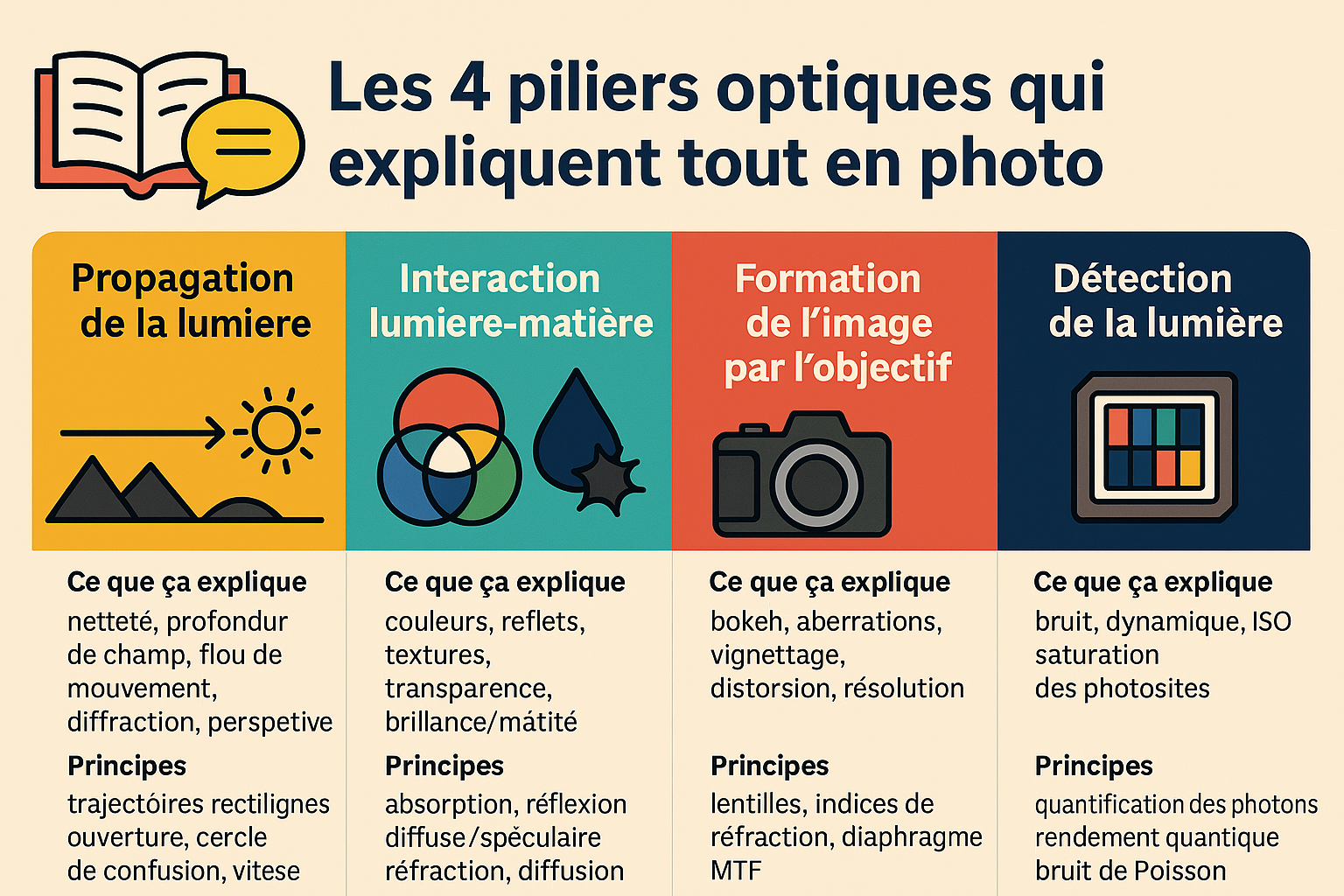

L’optique est la branche de la physique qui étudie la lumière comment elle se propage, comment elle interagit avec la matière, comment elle traverse un objectif et comment elle est finalement captée par un capteur. Chaque phénomène visible dans une image, du bokeh au bruit, des couleurs à la profondeur de champ, découle directement d’un principe optique identifiable.

Cet article n’est pas là pour t’apprendre des réglages. Il est là pour te montrer la structure invisible derrière tous les réglages. Une fois que tu comprends ces 4 piliers, tout le reste de la photographie devient logique et prévisible.

Pilier 1 : La propagation de la lumière

Trajectoire rectiligne et perspective

La lumière voyage en ligne droite. C’est un principe fondamental de l’optique, et c’est exactement ce qui crée la perspective dans tes photos. Quand tu pointes ton appareil vers une scène, les rayons lumineux qui viennent de chaque point de cette scène voyagent en ligne droite jusqu’à ton objectif. Plus un objet est loin, plus les rayons qui le représentent arrivent avec un angle différent, ce qui explique pourquoi les objets éloignés paraissent plus petits.

Cette trajectoire rectiligne explique aussi pourquoi les lignes droites dans la réalité restent droites dans tes photos, et pourquoi la distorsion que tu observes parfois avec certains objectifs est une déformation de ce principe naturel.

Ouverture, diffraction et limite de résolution

L’ouverture de ton objectif contrôle la quantité de lumière qui entre, mais elle a aussi un effet direct sur la netteté maximale que tu peux atteindre. Quand tu fermes beaucoup ton diaphragme pour avoir une grande profondeur de champ, tu arrives à un point où la lumière commence à se courber légèrement en passant par une ouverture trop petite. Ce phénomène s’appelle la diffraction, et il réduit la netteté de ton image même si techniquement tout est en focus.

Chaque objectif a donc une ouverture optimale. Trop ouverte, certaines aberrations apparaissent. Trop fermée, la diffraction réduit la résolution. C’est l’optique qui fixe cette limite, pas le marketing du fabricant.

Pour bien comprendre comment l’ouverture influence tes photos, je t’invite à lire cet article : Choisir la bonne ouverture

Cercle de confusion et profondeur de champ

Quand tu mets le focus sur un sujet, les objets devant et derrière ce sujet ne sont pas parfaitement nets. Ils projettent sur le capteur ce qu’on appelle un cercle de confusion. Tant que ce cercle est suffisamment petit pour paraître net à l’œil, l’objet semble en focus. Dès qu’il dépasse un certain seuil, il devient visible comme du flou.

La profondeur de champ, c’est exactement la zone où ces cercles de confusion restent assez petits pour paraître acceptables. Elle dépend de trois facteurs : l’ouverture, la distance de mise au point et la focale. Ces trois variables sont toutes des paramètres optiques.

Temps d’exposition et flou de mouvement

La lumière met du temps à traverser ton objectif et à exposer ton capteur. Plus tu laisses l’obturateur ouvert longtemps, plus un sujet en mouvement va se déplacer pendant que le capteur enregistre la lumière, ce qui crée le flou de mouvement. C’est une conséquence directe de la propagation de la lumière dans le temps.

Pour maîtriser l’exposition dans son ensemble, consulte cet article : Comprendre et maîtriser le triangle d’exposition

Pilier 2 : L’interaction lumière et matière

Absorption et couleur

Les objets n’ont pas de couleur en eux-mêmes. Ce que ton œil perçoit comme de la couleur, c’est en réalité la lumière que l’objet n’a pas absorbée. Un objet rouge absorbe toutes les longueurs d’onde de la lumière sauf le rouge, qu’il réfléchit vers ton objectif. Un objet noir absorbe presque tout. Un objet blanc réfléchit presque tout.

C’est pour ça que les couleurs changent selon la lumière ambiante. Sous une lumière chaude, un objet blanc paraît légèrement jaune parce que la source lumineuse elle-même est dominée par ces longueurs d’onde. La balance des blancs dans ton appareil tente de corriger cet effet en compensant la teinte de la source lumineuse.

Réflexion diffuse et spéculaire

Il existe deux types de réflexion. La réflexion diffuse se produit sur les surfaces mates. La lumière rebondit dans toutes les directions, ce qui donne un aspect uniforme et sans éclat. La réflexion spéculaire se produit sur les surfaces lisses et brillantes, comme un miroir, une vitre ou une carrosserie de voiture. La lumière rebondit dans une direction précise, ce qui crée des reflets et des hautes lumières intenses.

Comprendre ces deux types de réflexion t’aide à anticiper comment la lumière va se comporter sur tes sujets, et à choisir ton angle de prise de vue pour éviter les reflets indésirables ou au contraire pour les utiliser comme élément créatif.

Réfraction et transparence

Quand la lumière passe d’un milieu à un autre, par exemple de l’air au verre, elle change de direction. C’est la réfraction. C’est exactement ce principe qui est au cœur du fonctionnement de chaque lentille dans ton objectif. En courbant les rayons lumineux de manière contrôlée, les lentilles permettent de concentrer la lumière au bon endroit sur le capteur.

La réfraction explique aussi les déformations que tu observes quand tu photographies à travers une vitre, de l’eau ou tout autre milieu transparent différent de l’air.

Diffusion atmosphérique

L’air n’est pas parfaitement transparent. Il contient des particules microscopiques qui diffusent la lumière dans toutes les directions. C’est pour cette raison que le ciel est bleu, que les couchers de soleil sont orangés et rouges, et que les paysages lointains semblent couverts d’une légère voile bleutée. Cette diffusion atmosphérique crée aussi ce que les photographes appellent la brume de chaleur ou le voile dans les longues focales.

Pour mieux comprendre comment ton œil et ton appareil perçoivent la lumière différemment, lis cet article : Différences entre l’œil et un appareil photo

Pilier 3 : La formation de l’image par l’objectif

Le modèle des lentilles

Un objectif photo n’est pas une simple vitre. C’est un système complexe de lentilles courbées qui travaillent ensemble pour concentrer les rayons lumineux venant de la scène et les projeter avec précision sur le capteur. Chaque lentille dévie la lumière selon son indice de réfraction et sa courbure.

La distance focale de ton objectif, exprimée en millimètres, est une conséquence directe de la géométrie de ce système de lentilles. Un objectif de 50 mm et un de 200 mm font la même chose en principe, mais à des distances et des angles différents.

Pour mieux choisir tes objectifs, consulte cet article : Les focales fixes

Les aberrations optiques

Aucun objectif n’est parfait. Même les meilleurs objectifs au monde présentent des aberrations optiques, c’est-à-dire des défauts dans la manière dont ils forment l’image. Les aberrations chromatiques créent des franges de couleur sur les contours. Les aberrations sphériques réduisent la netteté au centre ou en périphérie. La coma déforme les points lumineux en forme de comète vers les bords de l’image.

Aujourd’hui, les fabricants utilisent des corrections optiques intégrées à l’objectif, mais aussi des corrections numériques appliquées par l’appareil ou en postproduction. Même l’intelligence artificielle est présentement utilisée pour corriger certaines aberrations en temps réel dans les appareils modernes. Mais ces corrections ne font que compenser des phénomènes optiques bien réels.

Bokeh et géométrie du diaphragme

Le bokeh, ce flou d’arrière-plan si recherché en portrait, est une conséquence directe de la géométrie de ton diaphragme. Les sources lumineuses hors focus se transforment en disques dont la forme reflète exactement la forme de ton ouverture. Un diaphragme avec de nombreuses lames arrondies crée un bokeh circulaire et doux. Un diaphragme avec peu de lames crée des formes polygonales plus visibles.

La qualité du bokeh dépend donc des choix optiques du fabricant, pas de la magie ou du prix de l’objectif.

Résolution et MTF

La résolution d’un objectif se mesure avec ce qu’on appelle la MTF, pour Modulation Transfer Function. C’est une mesure de la capacité de l’objectif à transférer les détails fins de la scène vers le capteur. Un objectif avec une MTF élevée reproduit les détails avec précision. Un objectif avec une MTF faible les rend flous et sans contraste.

C’est la MTF qui explique pourquoi deux objectifs peuvent avoir la même focale et le même prix, mais produire des résultats visuellement très différents.

Pour comprendre pourquoi tes photos peuvent manquer de netteté, lis cet article : Pourquoi vos photos sont floues

Pilier 4 : La détection de la lumière

Photons et statistique de Poisson

La lumière n’est pas un flux continu. Elle est composée de particules appelées photons. Quand ton capteur reçoit de la lumière, il compte littéralement des photons. Et comme tout comptage de particules aléatoires, ce processus obéit à des lois statistiques. Plus tu reçois de photons, plus le comptage est précis et moins il y a de variation aléatoire.

C’est pour ça que les photos prises en plein soleil sont nettes et sans bruit, pendant que les photos prises dans une pièce sombre montrent du grain. Dans les deux cas, c’est la même physique, mais avec des quantités de photons très différentes.

ISO et amplification

L’ISO n’est pas une sensibilité magique. C’est simplement un niveau d’amplification électronique du signal capté par le capteur. Quand tu montes ton ISO, tu demandes à l’électronique d’amplifier ce que le capteur a reçu. Le problème, c’est que cette amplification augmente aussi le bruit électronique inhérent au capteur.

Présentement, les capteurs hybrides modernes et les capteurs empilés permettent d’amplifier le signal plus tôt dans le processus, ce qui réduit le bruit résiduel. Et l’intelligence artificielle intégrée dans certains appareils actuels peut réduire le bruit en analysant l’image en temps réel, avant même que tu n’aies à toucher à quoi que ce soit en postproduction. Mais même avec toute cette technologie, le phénomène de base reste optique : c’est la quantité de photons disponibles qui détermine la qualité du signal.

Pour tout savoir sur l’ISO, consulte cet article : L’essentiel sur l’ISO en photographie

Dynamique et saturation

La dynamique d’un capteur, c’est sa capacité à enregistrer à la fois les zones très sombres et les zones très lumineuses d’une scène. Quand un photosite du capteur reçoit trop de photons, il sature, c’est-à-dire qu’il ne peut plus distinguer les nuances. C’est ce qui crée les hautes lumières brûlées dans tes photos.

Les capteurs actuels, notamment grâce au HDR multi-exposition et aux capteurs à global shutter, ont considérablement amélioré cette dynamique. Mais la limite reste fixée par la physique du capteur et la quantité de photons qu’il peut recevoir avant saturation.

Pour comprendre la dynamique en profondeur, lis cet article : La plage dynamique en photographie

Filtre de Bayer et conversion numérique

La grande majorité des capteurs photo ne voient pas les couleurs directement. Ils sont recouverts d’une grille de filtres colorés appelée matrice de Bayer, alternant rouge, vert et bleu. Chaque photosite ne capte qu’une seule couleur. Un algorithme appelé démosaïcisation reconstitue ensuite les couleurs complètes en interpolant les valeurs voisines.

C’est ce processus qui explique pourquoi la conversion RAW dans un logiciel peut influencer la qualité des couleurs de ton image. Aujourd’hui, certains logiciels utilisent l’intelligence artificielle pour améliorer cette reconstitution et récupérer des détails que les algorithmes traditionnels auraient perdus.

Pour mieux comprendre le fonctionnement global de ton appareil, consulte cet article : Comment fonctionne un appareil photo

Pourquoi l’optique explique 100 % des phénomènes lumineux

Maintenant que tu as vu les 4 piliers, tu comprends mieux pourquoi on peut affirmer que l’optique explique absolument tout en photographie. Même ce qui semble purement électronique ou numérique, comme le bruit ISO ou la dynamique, découle d’un phénomène optique fondamental : la quantité et la nature des photons que le capteur a reçus.

L’électronique ne fait que traduire ce que l’optique a produit. Le logiciel ne fait que corriger ce que la physique a imposé. La photographie n’est pas une technologie : c’est une conséquence directe de l’optique.

Une métaphore pour bien comprendre : la lumière est une langue, et l’optique est sa grammaire. La propagation de la lumière, c’est la syntaxe qui organise l’espace. L’interaction lumière et matière, c’est le vocabulaire des couleurs et des textures. La formation de l’image par l’objectif, c’est la conjugaison qui transforme la phrase selon l’outil utilisé. La détection par le capteur, c’est l’orthographe qui inscrit la phrase sur le papier.

Quand tu maîtrises la grammaire, tu peux écrire n’importe quelle phrase. Quand tu comprends l’optique, tu peux anticiper et créer n’importe quelle image.

Version simplifiée pour les débutants

Si tout ce qui précède te semble encore complexe, voici l’essentiel en quatre idées simples.

La lumière voyage en ligne droite, ce qui crée la perspective et le flou de mouvement. Les objets absorbent certaines couleurs et réfléchissent d’autres, ce qui explique tout ce que tu vois en termes de teintes et de textures. Ton objectif courbe la lumière avec précision pour former une image nette sur ton capteur, et les imperfections de cet objectif expliquent les défauts visuels que tu peux observer. Finalement, ton capteur compte des photons, et le nombre de photons disponibles détermine la qualité et le bruit de ton image.

C’est tout. Ces quatre idées suffisent à expliquer 100 % de ce que tu vois dans tes photos.

Foire aux questions

L’optique explique-t-elle vraiment tout en photographie? Oui, même ce qui semble électronique ou numérique comme le bruit ou la dynamique découle d’un phénomène optique de base : la quantité de photons captés. L’électronique et le logiciel traduisent et corrigent ce que l’optique a produit, mais ne peuvent pas créer de l’information que la lumière n’a pas fournie.

Quelle est la différence entre optique et électronique en photographie? L’optique gère tout ce qui concerne la lumière : sa propagation, son interaction avec la matière, sa mise en forme par l’objectif et sa détection par le capteur. L’électronique amplifie et convertit le signal lumineux en données numériques. L’une sans l’autre ne fonctionne pas, mais c’est toujours l’optique qui fixe les limites fondamentales.

Pourquoi la diffraction réduit-elle la netteté? En fermant beaucoup ton diaphragme, tu forces la lumière à passer par une très petite ouverture. À ce moment, la lumière commence à se courber légèrement au lieu de voyager en parfaite ligne droite. Ce phénomène, appelé diffraction, crée un léger flou qui réduit la netteté globale de l’image même si tout est techniquement en focus.

Le bruit est-il un phénomène optique? Oui, indirectement. Le bruit photographique provient principalement du nombre insuffisant de photons reçus par le capteur. Moins il y a de photons, plus le comptage est imprécis et plus le bruit est visible. L’amplification électronique de l’ISO aggrave ce bruit, mais la cause première reste optique.

La profondeur de champ est-elle liée à l’objectif ou au capteur? Les deux jouent un rôle. L’objectif détermine la mise au point et l’ouverture, qui sont les principaux facteurs. Mais la taille du capteur influence aussi la profondeur de champ, car un grand capteur nécessite une distance focale plus longue pour le même angle de vue, ce qui réduit la profondeur de champ à ouverture équivalente.

Ne manque aucun article

Chaque nouvelle publication arrive directement dans ta boîte de courriels. Pas de pub, pas de superflu. Juste de la photo.